RAG

RAG Retrieval-Augmented Generation

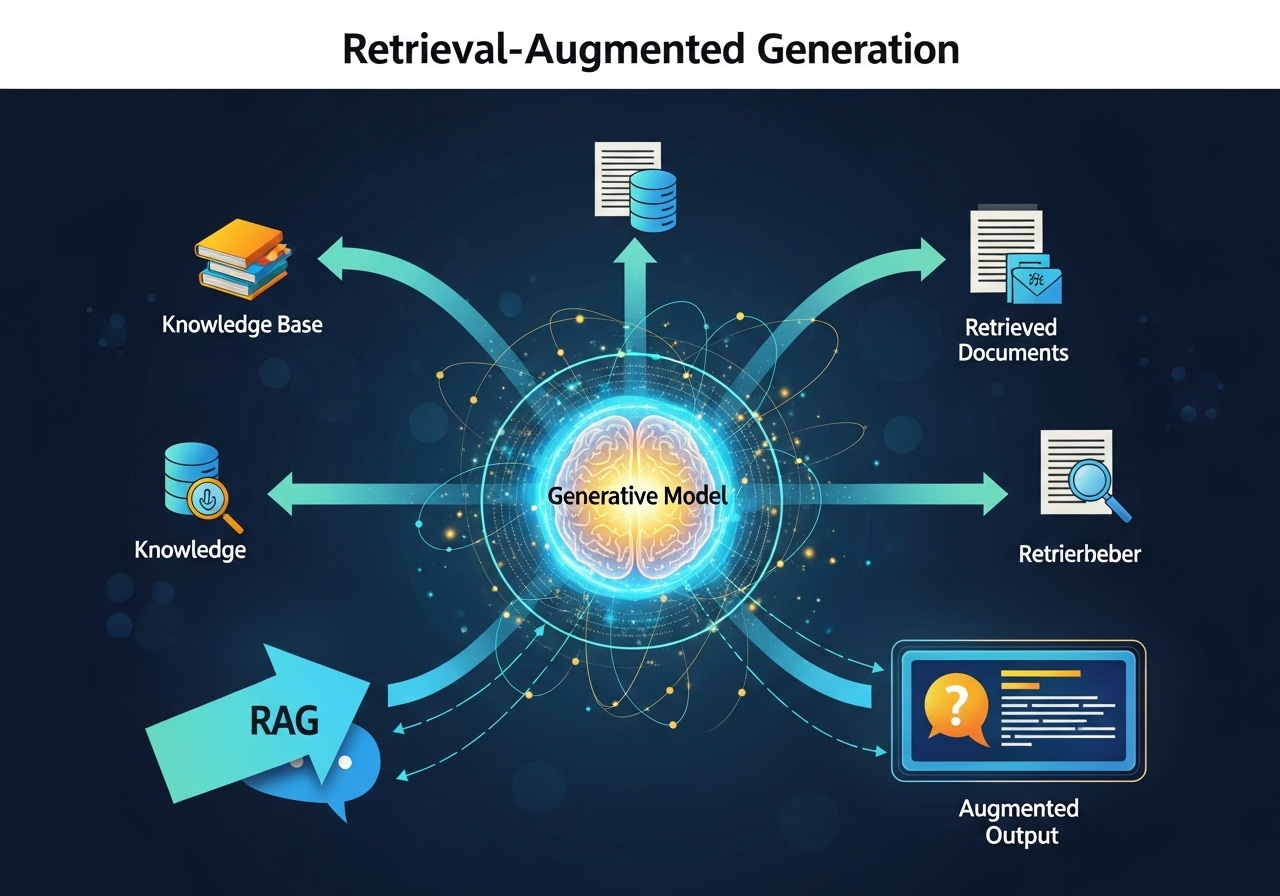

RAG检索增强生成是一种结合信息检索与大语言模型的技术框架。

核心是通过外部知识库动态检索相关信息,将其与用户问题结合,增强模型生成答案的准确性和专业性。RAG无需修改模型参数,而是以外挂方式扩展LLM的知识边界,尤其适用于知识密集型任务(如问答、文档分析)。

RAG相当于给大模型外接了一个移动硬盘。当大模型遇到不确定的问题时,会先从这个硬盘里面快速搜索相关知识点,再结合自己本身的记忆给出更靠谱的答案,避免瞎编或过时信息的问题。

RAG原理

数据准备:将文档拆解、编码为向量存入数据库。

检索增强:将用户问题编码后匹配相似向量片段。

生成优化:将检索结果与大模型能力结合,通过提示模版生成最终答案。

RAG怎么用

ChatPDF:用户上传PDF后,RAG自动解析文本、建立索引(OpenAI,Cohere等模型的Embeddings API允许用户传入自己的文本数据进行向量化处理),回答时检索相关内容生成总结,适合学术文献分析。

金融领域:银行用RAG构建智能客服,检索内部政策文档和产品手册,生成合规且专业的回复,避免信息泄露风险。

企业知识库:通过RAG系统,支持动态更新知识库(如产品手册、行业报告),提升模型在专业领域的实用性。

总结

RAG是大模型的外挂大脑,通过三步解决问题:1.存资料(分块、向量化存数据库)2.查资料(根据问题快速匹配相关内容)3.写答案(结合资料和自身知识生成回答)。它解决了大模型知识过时,胡编乱造的痛点,尤其适合需要实时更新和专业性的场景,比如法律咨询、医疗诊断。

本博客所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明来源 提拉的Studio!