思维链

发表于|更新于|大模型

|浏览量:

思维链 Chain of thought

思维链CoT是大语言模型通过分步骤推理提升答案准确性的技术。其核心是将复杂问题拆解为多个子任务,生成中间推理结果(如PPI),再整合为最终输出,模仿人类逐步思考的过程。

思维链的原理

传统模型直接从输入到输出,而CoT通过算法函数(R函数拆解任务、E函数整合结果)实现分步推理。模型参数规模(如137B)越大,CoT能力越强,但依赖人工设计提示词,且单模态场景有局限。

思维链实践案例

Deepseek R1交互:页面展示分步推理过程,如先展示思考过程再生成结果。

提示词工程:提问时加“请逐步思考”,准确率显著提升,如文献综述分阶段完成。

知识图谱生成:用CoT拆解任务为实体提取、关系分析等步骤。

总结

CoT通过分步推理提升大模型答案的准确性和可解释性,但依赖人工设计提示词,且对创新性问题(如数学猜想)泛化能力有限。它是当前提升模型表现的有效工具,但非终极方案。

文章作者: TinaHer

版权声明: 本博客所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明来源 提拉的Studio!

相关推荐

2025-07-18

Agent

AgentAgent是一种基于大型语言模型的智能体,能够通过自主感知、规划、决策和执行完成复杂任务。它具备环境交互能力,可调用工具、记录历史信息,并根据目标拆解问题步骤,最终输出解决方案。 Agent就像一个全能助手,不仅可以回答问题,还能主动帮你完成任务,会做事。 Agent原理Agent的核心架构包括大语言模型(理解意图)、记忆模块(记录长期经验与短期上下文)、规划模块(拆解目标为子任务)和工具调用模块(执行如搜索API、写代码等操作)。通过模仿人类“目标-反思-行动”的思维链,实现任务闭环。 Agent实践案例会议助手:自动预定会议、发送通知、总结纪要,还能跨平台搜索并整理资料。个人助手:如“扣子”平台,用户可通过拖拽工具模块(日历、支付等)自定义Agent,实现自动记账、会议提醒等功能。智能客服:用户提问时,Agent先检索知识库,再调用订单查询接口,最终用自然语言生成回复,并记录问题到“长期记忆”以优化后续服务。 总结大模型Agent是能独立完成复杂任务的智能体,技术核心在于模拟人类思维链,结合记忆、规划和工具调用。当前已应用于客服、办公等场景,未来可能成为AI领域的“...

2025-07-18

MCP

MCP Model Context ProtocolMCP(模型上下文协议)是由Anthropic于2024年11月提出的开放协议,旨在为大语言模型与外部数据源、工具之间建立标准化接口。它采用客户端-服务器架构,定义统一的通信规范,使大模型能动态调用实时数据(如数据库、API)和功能(如绘图、文件操作),打破模型训练的信息孤岛。 MCP就像一个万能插座,让大模型能即插即用地连接各种工具和数据。比如,原本大模型不知道今天天气,但通过MCP协议,它能调用天气预报接口,像人一样实时查数据回答问题。 MCP原理MCP Host(主机环境):集成大模型的应用程序(如VSCode Copilot,Dify,Coze),负责执行AI任务并运行MCP客户端。MCP Client(客户端):作为中介模块(如Cursor),在主机环境中管理通信,向服务器查询可用工具列表、转发调用请求,并处理响应。MCP server(服务器端):封装外部工具接口(如数据库、API)。 MCP就像工厂流水线,主机运行AI大脑干活,客户端负责传话找工具,服务器存着数据库等外挂设备,客户端把需求告诉服务器,拿到结果再传回...

2025-07-18

Prompt

PromptPrompt(提示词)是用户与大语言模型交互时输入的指令或文本片段,用于引导模型生成符合预期的内容。它可以是问题、任务描述,或包含背景、示例的结构化文本,本质上是人与模型沟通的桥梁。 为什么Prompt重要Prompt工程的核心意义在于解决大模型的模糊性。模型虽然拥有海量知识,但无法直接理解人类意图,它不会通过一个眼神读懂你,你需要清晰告诉它你需要具体的什么,希望它怎么做。通过设计优质prompt,可以明确任务边界、提供上下文,从而缩小模型的想象空间,提升输出的相关性和准确性。 怎么写出优质提示词明确任务:用动词开头(如“总结”、“对比”等),指定输出角色(如“你是一名律师”)提供上下文:补充背景信息(如“用户是新手妈妈”)和示例结构化格式:要求分点、表格或JSON输出优化策略:使用RTF框架(角色-任务-格式)、思维链(“请逐步分析”,“请给出详细步骤”) 告诉大模型要干嘛,然后补充一些背景资料让它知道,最后规定答案格式,告诉它你要的是什么。 总结Prompt是与大模型高效沟通的密码。通过明确指令、补充细节和规范格式,将模糊需求转化为机器可执行的任务。

2025-07-18

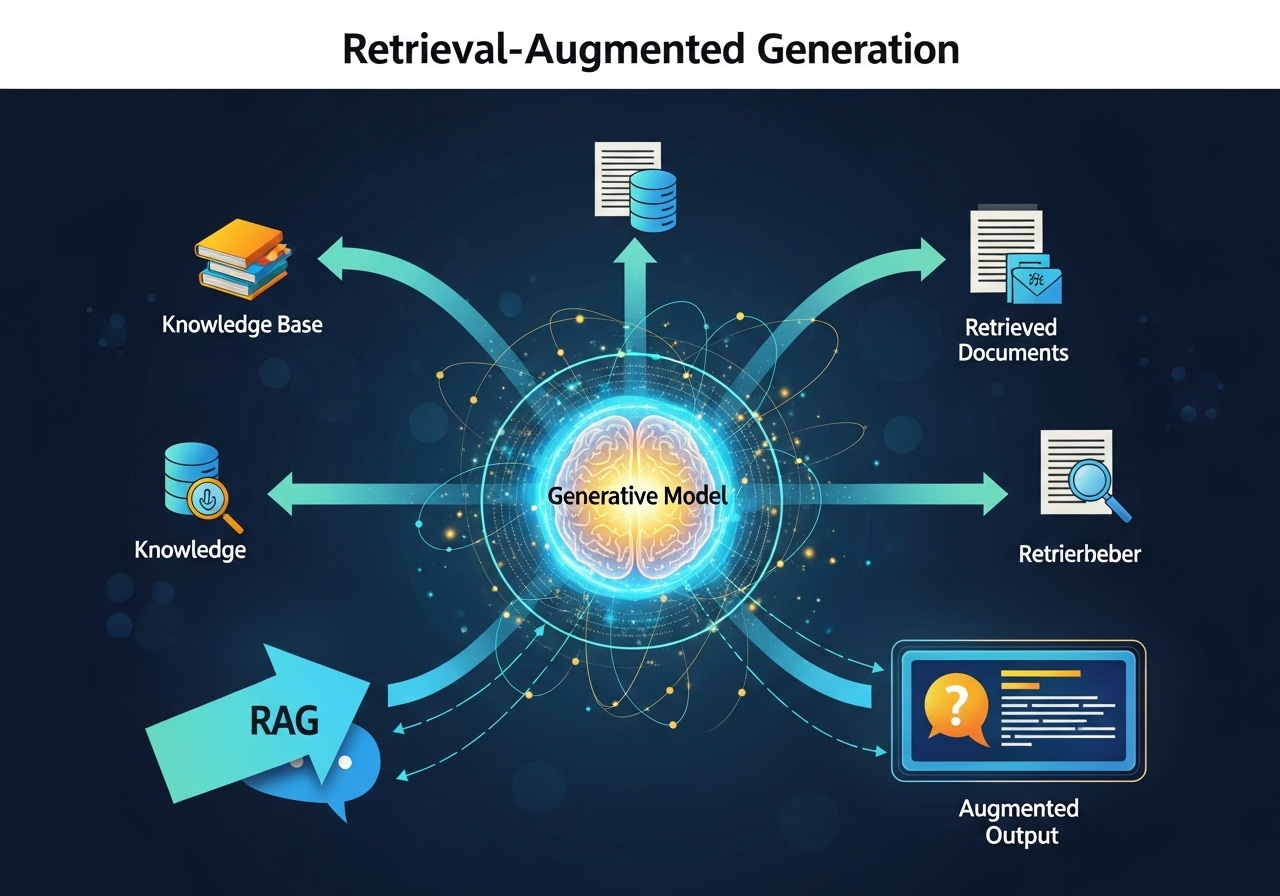

RAG

RAG Retrieval-Augmented GenerationRAG检索增强生成是一种结合信息检索与大语言模型的技术框架。核心是通过外部知识库动态检索相关信息,将其与用户问题结合,增强模型生成答案的准确性和专业性。RAG无需修改模型参数,而是以外挂方式扩展LLM的知识边界,尤其适用于知识密集型任务(如问答、文档分析)。 RAG相当于给大模型外接了一个移动硬盘。当大模型遇到不确定的问题时,会先从这个硬盘里面快速搜索相关知识点,再结合自己本身的记忆给出更靠谱的答案,避免瞎编或过时信息的问题。 RAG原理数据准备:将文档拆解、编码为向量存入数据库。检索增强:将用户问题编码后匹配相似向量片段。生成优化:将检索结果与大模型能力结合,通过提示模版生成最终答案。 RAG怎么用ChatPDF:用户上传PDF后,RAG自动解析文本、建立索引(OpenAI,Cohere等模型的Embeddings API允许用户传入自己的文本数据进行向量化处理),回答时检索相关内容生成总结,适合学术文献分析。金融领域:银行用RAG构建智能客服,检索内部政策文档和产品手册,生成合规且专业的回复,避免信息泄露风险...

2025-07-18

Token

TokenToken是大语言模型处理文本的最小语义单元,通过分词算法将原始文本切割为可计算的离散符号。不同于传统的汉字或单词,它采用BPE等算法实现跨语言混合拆分,每个token对应词表中的唯一ID并转换为高维向量。 Token就像是组成物质的基础颗粒,它有自己的编号和数字坐标,编号是它的唯一id,而数字坐标由embedding得来,是一个高维向量,由输入的数据集得来。 为什么Token重要Token是模型资源消耗的计算单位,直接影响API调用成本(如GPT-4每千token约0.3元)、上下文记忆长度(如4096 tokens限制)和生成质量。合理的token使用能优化算力分配,避免关键信息被截断。 这其实是影响和大模型对话的三大体验:要花多少钱、能聊多长、回答质量。 怎么减少Token输入优化:删除冗余词 (“那个…嗯”,重复语义的)参数控制:设置max_tokens = 300限制回答长度长文本处理:分段输入+用“继续”指令衔接监控用量:调用API时查看usage字段 总结Token是AI理解人类语言的乐高积木,既决定了大模型的算力成本,又影响着对话质量。掌握分词...

2025-07-18

Transformer

TransformerTransformer是一种基于自注意力机制的神经网络架构,专为处理序列数据(如文本、语音)而设计。其核心由编码器encoder和解码器decoder组成,编码器负责提取输入序列的全局特征,解码器则根据编码结果生成输出。通过位置编码保留序列顺序信息,并通过多头注意力机制并行捕捉不同维度的语义关联。 Transformer就像一个超级大脑,它的设计让它可以同时并行分析一句话里所有词的关系,不需要像传统模型那样逐字读。 Transformer原理Transformer通过一种叫“自注意力”的技术,能够同时关注句子中的所有单词,理解它们之间的关系。 Transformer实践案例GPT系列:基于纯解码器架构,通过海量文本预训练生成连贯内容,如写文章、编程代码。BERT:基于编码器的模型,擅长理解语义,用于搜索引擎优化和问答系统。Sora:结合扩散模型与transformer,生成高质量视频,体现多模态扩展能力。 GPT像作家,输入主题就能编故事;BERT像学霸,擅长考试中的阅读理解;Sora则是导演,用文字描述就能生成视频。它们的共同点是用transformer分...

公告

认真记录生活,欢迎来到我的小世界