大模型幻觉

大模型幻觉 Model Hallucination

大模型幻觉指模型生成的内容存在不符合现实事实(事实性幻觉)或偏离用户指令/上下文(忠实性幻觉)的现象。

事实性幻觉:分为“事实不一致”(错误引用信息)和“事实捏造”(无中生有)。

忠实性幻觉:包括指令、上下文或逻辑不一致(如答非所问、自相矛盾)。

为什么有幻觉

幻觉源于数据缺陷(错误、偏见、过时知识)、训练过程问题(模型架构偏差、对齐目标冲突)和推理阶段的不确定性(随机抽样、解码策略不完美)。

总的来说就是3个方面,1是喂的数据本身不够客观,模型学坏了。2是训练方法没调好,导致模型学歪。3是推理时像抽奖,模型可能随便蒙答案。

怎么解决幻觉

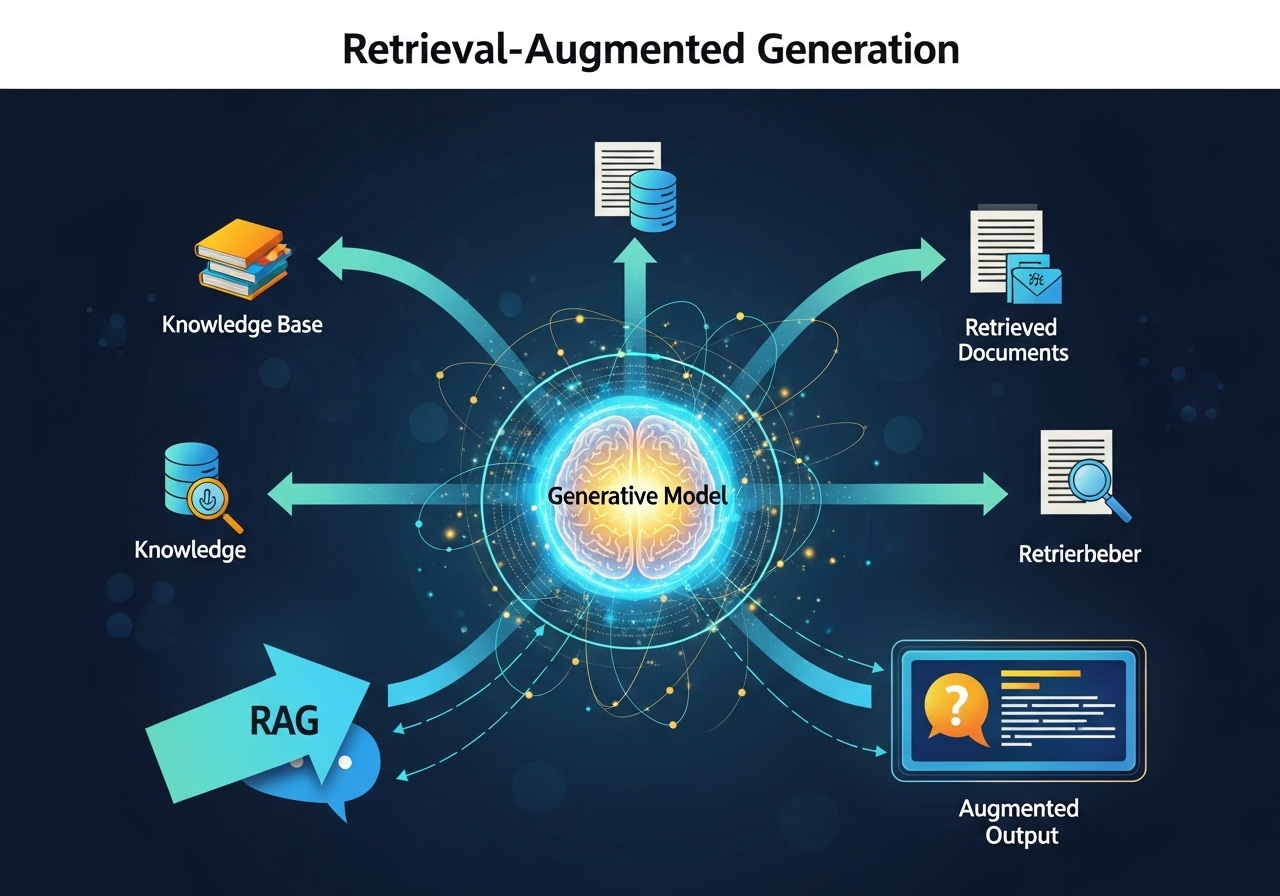

检测:用外部知识库验证事实性幻觉(如查百科),通过逻辑分析、指令匹配检测忠实性幻觉。

减轻:清洗数据、更新知识;优化训练策略(如强化对齐),推理时增加事实验证步骤(如引用权威来源)。

通俗说就是让模型自己在回答问题前去查资料,检查是否按要求答题以及答题是否符合事实规律,自行再调整。喂给模型更干净、与时俱进的数据,训练时盯紧目标(比如教它诚实),生成答案时候强制引用真实信息。

总结

大模型幻觉是“一本正经地胡说八道”,分事实错误和跑题两类,根源在数据、训练和推理。解决方法包括数据消毒、训练调优和推理增强。

幻觉虽然是大问题,但也可能是创新的火花。关键是学会如何驾驭它。

本博客所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明来源 提拉的Studio!